régression (suite)

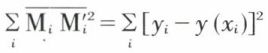

La méthode des moindres carrés utilisée pour déterminer les droites de régression implique, pour chacune d’elles, que la somme des carrés des distances de tous les points Mi à ces droites, mesurées parallèlement aux axes de coordonnées, est minimale : la droite de régression de Y en X, par exemple, est telle que l’expression

soit minimale. Le carré du coefficient de corrélation linéaire entre X et Y, appelé coefficient de détermination, mesure la fraction de la variance totale de l’une des variables Y (ou X), expliquée par l’autre variable X (ou Y), lorsqu’elle est exprimée en fonction de cette dernière par une équation de régression linéaire.

Si l’on considère l’estimation d’une variable Y en fonction de plusieurs variables (X1, X2, ..., Xn), l’hypothèse d’une régression linéaire multiple conduit encore à rechercher, par la méthode des moindres carrés, une équation de régression de la forme y (x1, x2, ...) = a + b1x1 + b2x2 + ∙∙∙ + bnxn, les coefficients de régression partielle b1, b2, ... caractérisant respectivement l’influence des variations de chaque variable Xi sur la variable Y. L’équation précédente définit un plan dans l’espace à n + 1 dimensions, ce plan de régression de Y en (X1, ..., Xn) étant tel que la somme des carrés des distances des points-observations à ce plan, mesurées parallèlement à l’axe des Y, soit minimale.

Le coefficient de corrélation multiple ou son carré, le coefficient de détermination multiple,

mesure l’étroitesse de la liaison entre les valeurs observées de la variable Y et les valeurs correspondantes estimées par l’équation de régression. Le terme régression curviligne désigne l’ajustement des valeurs observées de Y en fonction d’une ou plusieurs variables à l’aide d’une fonction non linéaire de ces variables.

En statistique théorique, pour deux variables X, Y dont la loi de densité de probabilité du couple (xy) est donnée, la courbe de régression de Y en x est le lieu des points de coordonnées [x, E (Y|x)], E (Y|x) étant l’espérance mathématique (ou valeur moyenne) de Y dans la distribution conditionnelle de Y pour une valeur particulière X = x. On définit de même la courbe de régression de X en y. Dans le cas d’une loi à un nombre quelconque n de variables, on définirait de manière analogue n + 1 surfaces de régression.

L’importance de la régression linéaire tient au fait que, dans une distribution normale à deux variables (cas fréquent, au moins approximativement), les courbes de régression sont les deux droites d’équations

les paramètres mx, my, σx, σy étant respectivement les moyennes et les écarts types des distributions marginales de X et Y, et ρ le coefficient de corrélation de ces deux variables. De même, dans une distribution normale à n variables, les n surfaces de régression sont des plans.

E. M.

➙ Ajustement statistique / Corrélation / Distribution statistique.

G. Calot, Cours de statistique descriptive (Dunod, 1964).